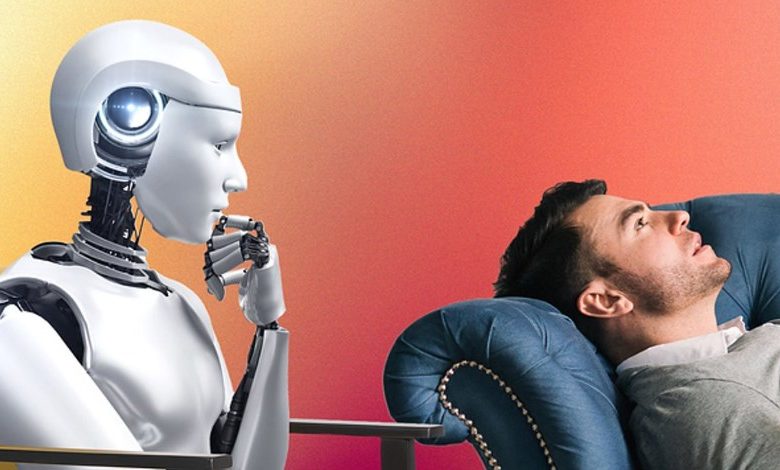

في عصر تسارعت فيه وتيرة التحول الرقمي وأصبح الذكاء الاصطناعي حاضرًا في معظم تفاصيل الحياة اليومية.ظهر مايسمى الذكاء الاصطناعي للدعم العاطفي حيث بدأت فئة من الناس بالاعتماد على منصات الدردشة المدعومة بالذكاء الاصطناعي للحصول على الدعم النفسي والعاطفي. مستخدمين هذه التقنية كبديل مؤقت أو دائم للمعالجين النفسيين. غير أن هذا الاستخدام المفرط والمندفع يطرح إشكاليات عميقة تتعلق بمدى خصوصية البيانات. إذ أكد “سام ألتمان”، المدير التنفيذي للشركة المطورة لأشهر منصات المحادثة الذكية. أن هناك ثغرة قانونية حقيقية تحيط بهذه الممارسة المتنامية. مشيرًا إلى أن المحادثات بين الإنسان والذكاء الاصطناعي لا تخضع لأي حماية قانونية شبيهة بتلك التي تضمن السرية بين الطبيب والمريض أو المحامي وموكله. ما يجعل المستخدم مكشوفًا في حال أية ملاحقة قضائية أو مساءلة قانونية لاحقة.

الذكاء الاصطناعي للدعم العاطفي .. الواقع القانوني

يعتمد الكثير من الشباب اليوم على برامج المحادثة الذكية لتفريغ مشاعرهم. أو طلب النصائح في قضايا عائلية، أو حتى استشارة افتراضية في مشاكلهم النفسية. ظنًا منهم أنهم يتحدثون إلى نظام آمن وموثوق. في حين أن الواقع التقني والقانوني يختلف تمامًا عن الصورة التي يحملونها في أذهانهم، ذلك أن حديثهم الصريح والمفتوح لا يندرج ضمن إطار قانوني يضمن لهم حق الخصوصية المطلقة. بل يمكن اعتباره جزء من البيانات التي تخضع لمراقبة محتملة في حال حدوث أية إجراءات قانونية. ووفقا لما ذكره ألتمان، فإن الشركة قد ترغم قانونيًا على تسليم هذه المحادثات إذا طلبت المحكمة ذلك. وهو ما يُعد تهديدًا مباشرًا لخصوصية الأفراد. خاصةً إذا كانت المحادثات تتعلق بمسائل حساسة كالاكتئاب. أو العلاقات الشخصية، أو حتى نوايا الانتحار.

حاجة المستخدم للدعم لا تبرر التهاون في الخصوصية

تدرك الشركات المطورة لهذه النماذج أن شعور المستخدم بالطمأنينة النفسية أثناء التفاعل مع الأنظمة الذكية لا يعني بالضرورة أن بياناته في مأمن, بل إن الحاجة العاطفية التي تدفعه للكلام بحرية قد تتحول لاحقًا إلى مصدر تهديد لخصوصيته. لا سيما في حال استخدام محتوى المحادثة ضده في سياقات خارجية. من جهتها، تقر الشركة بأن غياب أليات الحماية الصارمة للمحتوى العاطفي والنفسي قد يحد من انتشار خدماتها في هذا المجال. وتسعى إلى تحقيق توازن بين تحسين قدرة الذكاء الاصطناعي على الاستجابة الإنسانية من جهة. وضمان الخصوصية المطلقة للمستخدم من جهة أخرى, غير أن الواقع يظهر أن هذا التوازن لم يتحقق بعد. ما يجعل من الضروري تنبيه المستخدم إلى عدم اعتبار هذه المحادثات بديلًا حقيقيًا أو قانونيًا للعلاج النفسي أو الاستشارة المتخصصة.

في ظل التطور المتسارع للذكاء الاصطناعي، تبقى الأسئلة الأخلاقية والقانونية حاضرة بقوة، لا سيما في ما يتعلق باستخدام هذه التكنولوجيا في المجالات الحساسة مثل الدعم العاطفي والعلاج النفسي، وبينما تسعى الشركات إلى تطوير واجهات تفاعلية أكثر إنسانية، يجب أن تسبقها خطوات واضحة لتحديد الحقوق القانونية للمستخدمين، وتعزيز مفهوم الخصوصية الرقمية، فإلى أن يتم ذلك، على المستخدم أن يكون واعيًا بأن حديثه مع برنامج محادثة ذكي قد لا يظل بينه وبينه فقط، بل ربما يجد طريقه إلى ملفات قانونية، أو خوادم تحليل البيانات، وهو ما يجعل من التفكير قبل البوح أمرًا لا مفر منه.